tkprof工具的使用

- tkprof工具位于$ORACLE_HOME/bin目录下(查看命令which trcsess),用于格式化trace文件(也可以使用第三方的工具,格式化出来的更加美观和全面),从而可以非常方便的跟踪和诊断sql语句的执行效率;

- tkprof的语法;

- table:手动生成explain plan时,存储中间信息的临时表,默认为PROF$PLAN_TABLE;

- explain:手动生成explain时,连接数据库的用户名和密码;

- print:仅仅处理前integer数量的sql语句,如果我们需要生成脚本,该参数对脚本中包含的sql数量是不影响的;

- insert:生成脚本,该脚本会创建表,并把相关统计信息插入表,从而可以在数据库中查看;

- record:生成不包含递归sql的脚本文件;

- sys:是否包含sys用户执行的sql,大多数是递归sql;

- aggregate=no:如果设置为yes的话,会合并相同的sql语句,一般设置为no,分别查看每次的执行;

- waits:是否记录等待事件;

- sort:对sql语句排序的规则;

- 常用的语法:tkprof tracefiles outputfile sys=no aggregate=no;

- SQL Trace文件的内容:

- Parse, execute, and fetch counts:解析,执行,获取三个动作的执行次数;

- CPU and elapsed times:消耗的cpu时间和总时间,单位是秒;

- Physical reads and logical reads:物理读和逻辑读的次数;

- Number of rows processed:处理的记录数;

- Misses on the library cache:没有命中缓存的次数;

- Username under which each parse occurred:执行sql语句的用户;

- Each commit and rollback:每次的提交和回滚操作(tkprof不会处理这些信息);

- Wait event and bind data for each SQL statement:针对每条sql语句的等待事件和绑定变量信息;

- Row operations showing the actual execution plan of each SQL statement:sql语句的实际执行计划;

- Number of consistent reads, physical reads, physical writes, and time elapsed for each operation on a row;

- Sql Trace与执行计划:

- 在sql trace期间,如果sql语句的游标已经关闭,则在sql trace中会包含相应的执行计划,Example 1;

- 在sql trace期间,如果sql语句的游标没有关闭,则在sql trace中不会包含相应的执行计划;

- 如果之前sql语句已经执行过,则会包含执行计划;

- 如果在trace文件中不存在执行计划的相关信息,可以通过tkprof的explain参数来登陆数据库,并执行explain plan命令,把执行计划写入到trace文件中;

- 指定aggregate=yes,tkprof会汇总相同的sql语句信息,并在文件的最后汇总所有语句的相关信息;

- 使用insert和records参数的例子,Example 2;

- 注意一些陷阱:

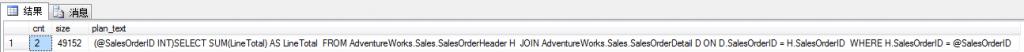

- Avoiding the Argument Trap:如果在运行时不注意绑定变量的问题,很可能会陷入参数陷阱,EXPLAIN PLAN命令不会检查SQL语句中绑定变量的类型,总是认为是VARCHAR类型;所以,如果绑定变量如果实际为number或者date类型的话,tkprof会进行一个隐式转换,导致生成错误的执行计划;为了避免这种情况,需要自己执行转换;

- Avoiding the Read Consistency Trap:如果要查询的数据被更新了,而且没有提交,那么很可能就会进入一致性读的陷阱,因为如果有很多相同的查询的操作的话,会一直构建CR块;

- Avoiding the Schema Trap:当看到一个只有少量数据返回却发现扫描了非常多的块的统计是,有可能是一下原因:

- 表被经常的更新/删除,造成了水位线很高;

- 可能tkprof分析的trace文件记录的是之前没有在表上创建索引情况,而之后加上了索引;

- Avoiding the Time Trap:当执行一个简单的sql,但是看到elapsed time时间特别长时,可能是再等待其它的锁;

————————————— tkprof的语法 —————————————

[oracle@singleton11g ~]$ tkprof

Usage: tkprof tracefile outputfile [explain= ] [table= ]

[print= ] [insert= ] [sys= ] [sort= ]

table=schema.tablename Use ‘schema.tablename’ with ‘explain=’ option.

explain=user/password Connect to ORACLE and issue EXPLAIN PLAN.

print=integer List only the first ‘integer’ SQL statements.

aggregate=yes|no

insert=filename List SQL statements and data inside INSERT statements.

sys=no TKPROF does not list SQL statements run as user SYS.

record=filename Record non-recursive statements found in the trace file.

waits=yes|no Record summary for any wait events found in the trace file.

sort=option Set of zero or more of the following sort options:

prscnt number of times parse was called

prscpu cpu time parsing

prsela elapsed time parsing

prsdsk number of disk reads during parse

prsqry number of buffers for consistent read during parse

prscu number of buffers for current read during parse

prsmis number of misses in library cache during parse

execnt number of execute was called

execpu cpu time spent executing

exeela elapsed time executing

exedsk number of disk reads during execute

exeqry number of buffers for consistent read during execute

execu number of buffers for current read during execute

exerow number of rows processed during execute

exemis number of library cache misses during execute

fchcnt number of times fetch was called

fchcpu cpu time spent fetching

fchela elapsed time fetching

fchdsk number of disk reads during fetch

fchqry number of buffers for consistent read during fetch

fchcu number of buffers for current read during fetch

fchrow number of rows fetched

userid userid of user that parsed the cursor

————————————— tkprof的语法 —————————————

————————————— Example 1 —————————————

— 1.使用hr用户登录,并查看sql语句的执行计划;

sqlplus / as sysdba

conn hr/hr

EXPLAIN PLAN FOR SELECT employee_id, email, salary FROM HR.EMPLOYEES WHERE employee_id = 100;

SELECT * FROM TABLE(DBMS_XPLAN.DISPLAY());

— 2.打开sql trace功能,然后设置标识符为E1,并执行sql语句;

ALTER SESSION SET SQL_TRACE=TRUE;

ALTER SESSION SET TRACEFILE_IDENTIFIER=’E1′;

SELECT employee_id, email, salary FROM HR.EMPLOYEES WHERE employee_id = 100;

— 3.格式化trace文件,然后查看执行计划:tkprof *_E1.trc e1.out sys=no aggregate=no;

————————————— Example 1 —————————————

————————————— Example 2 —————————————

— 1.使用hr用户登录,打开sql trace功能,然后设置标识符为E2,并执行sql语句;

sqlplus / as sysdba

conn hr/hr

ALTER SESSION SET SQL_TRACE=TRUE;

ALTER SESSION SET TRACEFILE_IDENTIFIER=’E2′;

SELECT USER FROM DUAL;

SELECT employee_id, email, salary FROM HR.EMPLOYEES WHERE employee_id = 200;

SELECT COUNT(*) FROM HR.DEPARTMENTS;

— 2.格式化trace文件,然后查看执行计划:tkprof *_E2.trc e2.out sys=no insert=insert.sql record=record.sql;

— 3.查看record.sql文件;

[oracle@singleton11g trace]$ less record.sql

SELECT USER FROM DUAL ;

SELECT employee_id, email, salary FROM HR.EMPLOYEES WHERE employee_id = 200 ;

SELECT COUNT(*) FROM HR.DEPARTMENTS ;

— 4.查看insert.sql文件;

REM Edit and/or remove the following CREATE TABLE

REM statement as your needs dictate.

CREATE TABLE tkprof_table

(

date_of_insert DATE

,cursor_num NUMBER

,depth NUMBER

,user_id NUMBER

,parse_cnt NUMBER

,parse_cpu NUMBER

,parse_elap NUMBER

,parse_disk NUMBER

,parse_query NUMBER

,parse_current NUMBER

,parse_miss NUMBER

,exe_count NUMBER

,exe_cpu NUMBER

,exe_elap NUMBER

,exe_disk NUMBER

,exe_query NUMBER

,exe_current NUMBER

,exe_miss NUMBER

,exe_rows NUMBER

,fetch_count NUMBER

,fetch_cpu NUMBER

,fetch_elap NUMBER

,fetch_disk NUMBER

,fetch_query NUMBER

,fetch_current NUMBER

,fetch_rows NUMBER

,ticks NUMBER

,sql_statement LONG

);

set sqlterminator off

INSERT INTO tkprof_table VALUES

(

SYSDATE, 2, 0, 84, 1, 2000, 2136, 0, 0, 0, 1

, 1, 0, 46, 0, 0, 0, 0, 0

, 2, 0, 26, 0, 0, 0, 1, 12753692

, ‘SELECT USER FROM DUAL

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 3, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 10, 0, 356, 0, 0, 0, 0, 0

, 10, 0, 448, 0, 40, 0, 10, 50095736

, ‘select obj#,type#,ctime,mtime,stime, status, dataobj#, flags, oid$, spare1, spa

re2 from obj$ where owner#=:1 and name=:2 and namespace=:3 and remoteowner is null

and linkname is null and subname is null

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 4, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 80, 0, 0, 0, 0, 0

, 2, 0, 267, 0, 8, 0, 2, 1674

, ‘select t.ts#,t.file#,t.block#,nvl(t.bobj#,0),nvl(t.tab#,0),t.intcols,nvl(t.cluc

ols,0),t.audit$,t.flags,t.pctfree$,t.pctused$,t.initrans,t.maxtrans,t.rowcnt,t.blk

cnt,t.empcnt,t.avgspc,t.chncnt,t.avgrln,t.analyzetime,t.samplesize,t.cols,t.proper

ty,nvl(t.degree,1),nvl(t.instances,1),t.avgspc_flb,t.flbcnt,t.kernelcols,nvl(t.tri

gflag, 0),nvl(t.spare1,0),nvl(t.spare2,0),t.spare4,t.spare6,ts.cachedblk,ts.cacheh

it,ts.logicalread from tab$ t, tab_stats$ ts where t.obj#= :1 and t.obj# = ts.obj#

(+)

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 5, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 118, 0, 0, 0, 0, 0

, 10, 2000, 2037, 0, 16, 0, 8, 3642

, ‘select i.obj#,i.ts#,i.file#,i.block#,i.intcols,i.type#,i.flags,i.property,i.pct

free$,i.initrans,i.maxtrans,i.blevel,i.leafcnt,i.distkey,i.lblkkey,i.dblkkey,i.clu

fac,i.cols,i.analyzetime,i.samplesize,i.dataobj#,nvl(i.degree,1),nvl(i.instances,1

),i.rowcnt,mod(i.pctthres$,256),i.indmethod#,i.trunccnt,nvl(c.unicols,0),nvl(c.def

errable#+c.valid#,0),nvl(i.spare1,i.intcols),i.spare4,i.spare2,i.spare6,decode(i.p

ctthres$,null,null,mod(trunc(i.pctthres$/256),256)),ist.cachedblk,ist.cachehit,ist

.logicalread from ind$ i, ind_stats$ ist, (select enabled, min(cols) unicols,min(t

o_number(bitand(defer,1))) deferrable#,min(to_number(bitand(defer,4))) valid# from

cdef$ where obj#=:1 and enabled > 1 group by enabled) c where i.obj#=c.enabled(+)

and i.obj# = ist.obj#(+) and i.bo#=:1 order by i.obj#

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 6, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 8, 1000, 301, 0, 0, 0, 0, 0

, 17, 0, 410, 0, 34, 0, 9, 2435

, ‘select pos#,intcol#,col#,spare1,bo#,spare2,spare3 from icol$ where obj#=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 7, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 200, 0, 0, 0, 0, 0

, 17, 1000, 402, 0, 6, 0, 15, 1796

, ‘select name,intcol#,segcol#,type#,length,nvl(precision#,0),decode(type#,2,nvl(s

cale,-127/*MAXSB1MINAL*/),178,scale,179,scale,180,scale,181,scale,182,scale,183,sc

ale,231,scale,0),null$,fixedstorage,nvl(deflength,0),default$,rowid,col#,property,

nvl(charsetid,0),nvl(charsetform,0),spare1,spare2,nvl(spare3,0) from col$ where o

bj#=:1 order by intcol#

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 8, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 10, 999, 293, 0, 0, 0, 0, 0

, 10, 0, 459, 0, 30, 0, 10, 3519

, ‘select type#,blocks,extents,minexts,maxexts,extsize,extpct,user#,iniexts,NVL(li

sts,65535),NVL(groups,65535),cachehint,hwmincr, NVL(spare1,0),NVL(scanhint,0),NVL(

bitmapranges,0) from seg$ where ts#=:1 and file#=:2 and block#=:3

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 9, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 8, 0, 199, 0, 0, 0, 0, 0

, 8, 0, 330, 0, 24, 0, 8, 2328

, ‘select o.owner#,o.name,o.namespace,o.remoteowner,o.linkname,o.subname from obj$

o where o.obj#=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 10, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 1000, 149, 0, 0, 0, 0, 0

, 2, 0, 119, 0, 4, 0, 0, 1135

, ‘select col#, grantee#, privilege#,max(mod(nvl(option$,0),2)) from objauth$ wher

e obj#=:1 and col# is not null group by privilege#, col#, grantee# order by col#,

grantee#

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 11, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 65, 0, 0, 0, 0, 0

, 5, 0, 179, 0, 6, 0, 3, 762

, ‘select grantee#,privilege#,nvl(col#,0),max(mod(nvl(option$,0),2))from objauth$

where obj#=:1 group by grantee#,privilege#,nvl(col#,0) order by grantee#

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 12, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 51, 0, 0, 0, 0, 0

, 9, 1000, 269, 0, 18, 0, 7, 1321

, ‘select con#,obj#,rcon#,enabled,nvl(defer,0),spare2,spare3 from cdef$ where robj

#=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 13, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 2, 0, 80, 0, 0, 0, 0, 0

, 16, 0, 290, 0, 32, 0, 14, 2173

, ‘select con#,type#,condlength,intcols,robj#,rcon#,match#,refact,nvl(enabled,0),r

owid,cols,nvl(defer,0),mtime,nvl(spare1,0),spare2,spare3 from cdef$ where obj#=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 14, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 14, 0, 336, 0, 0, 0, 0, 0

, 28, 0, 499, 0, 56, 0, 14, 4305

, ‘select intcol#,nvl(pos#,0),col#,nvl(spare1,0) from ccol$ where con#=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 15, 1, 0, 1, 1999, 1376, 0, 0, 0, 1

, 1, 2000, 2335, 0, 0, 0, 1, 0

, 1, 0, 26, 0, 2, 0, 1, 4365

, ‘select condition from cdef$ where rowid=:1

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 16, 1, 0, 0, 0, 0, 0, 0, 0, 0

, 3, 0, 71, 0, 0, 0, 0, 0

, 3, 0, 102, 0, 9, 0, 3, 905

, ‘select /*+ rule */ bucket_cnt, row_cnt, cache_cnt, null_cnt, timestamp#, sample

_size, minimum, maximum, distcnt, lowval, hival, density, col#, spare1, spare2, av

gcln from hist_head$ where obj#=:1 and intcol#=:2

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 2, 0, 84, 1, 17997, 16136, 0, 0, 0, 1

, 1, 0, 23, 0, 0, 0, 0, 0

, 2, 0, 78, 0, 2, 0, 1, 1010

, ‘SELECT employee_id, email, salary FROM HR.EMPLOYEES WHERE employee_id = 200

‘)

/

INSERT INTO tkprof_table VALUES

(

SYSDATE, 15, 0, 84, 1, 8999, 9177, 0, 0, 0, 1

, 1, 1000, 113, 0, 0, 0, 0, 0

, 2, 0, 254, 0, 1, 0, 1, 2161

, ‘SELECT COUNT(*) FROM HR.DEPARTMENTS

‘)

/

COMMIT;

set sqlterminator on

————————————— Example 2 —————————————

.jpg)

.jpg) Prof. Dr. Stefan Edlich是德国柏林Beuth HS技术(University of App. Sc.)的高级讲师。他为诸多出版社如Apress、OReilly、Spektrum/Elsevier等编写了超过10本IT图书。他维护着

Prof. Dr. Stefan Edlich是德国柏林Beuth HS技术(University of App. Sc.)的高级讲师。他为诸多出版社如Apress、OReilly、Spektrum/Elsevier等编写了超过10本IT图书。他维护着.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)